8. FÍSICA DE FRONTERA

8.1. La gravedad cuántica

Renormalización.

En el capítulo anterior resumimos los principales aspectos del modelo estándar de la física de partículas, resumiendo las principales características de tres fuerzas de la naturaleza: la electromagnética, la nuclear débil y la nuclear fuerte. La gravedad no fue tenida en cuenta, ya que actualmente se encuentra fuera de dicho modelo, siendo únicamente explicada por la teoría de la relatividad general de Einstein. Los intentos de cuantizar el campo gravitatorio en el marco de la teoría cuántica de campos han dado malos resultados irremediablemente, y una de las principales causas es la renormalización.

Dentro del modelo estándar, donde el principio de incertidumbre está a la orden del día, se considera habitual que durante tiempos muy pequeños sucedan diversos procesos que violen los teoremas de conservación habituales, durante los cuales se crean partículas virtuales que desaparecen sin poder llegar a ser detectadas. Estas son conocidas como las partículas del vacío, o más comúnmente como el vacío cuántico. En efecto, cuando consideramos la teoría cuántica de campos correcta la noción de vacío clásica tiene que dar lugar a un montón de partículas virtuales imposibles de detectar.

Esto significa que una partícula cualquiera, en promedio, no es solo ella misma propagándose por el espacio-tiempo, sino que además engloba los efectos de todas las partículas virtuales que produce de forma continuada. Surgió así el problema de que las contribuciones de estas, aparentemente ilimitadas, darían lugar a magnitudes físicas de valor infinito: por ejemplo, si la masa de un electrón es en realidad la suya más la de las infinitas partículas de vacío que lo pueden acompañar, esta se dispararía hasta el infinito en seguida.

Pero gracias al trabajo de Feynman, entre otros, podemos estar seguros de que las contribuciones del vacío se pueden ignorar y los infinitos se cancelan. A dicho resultado se lo conoce como renormalización, ya que devuelve los parámetros de las partículas a la «normalidad». Y por cuestiones obvias, una teoría de campos que no sea renormalizable no puede ser real: produciría resultados infinitos sin ningún sentido.

Por supuesto, este es el caso de la gravedad, entendida como el campo de curvatura del espacio-tiempo de Einstein. Si bien la cuantización de la teoría electromagnética de Maxwell da lugar a vértices y procesos renormalizables, no sucede lo mismo con la relatividad general. Sus infinitos, como se suele decir, son reales.

A partir de aquí, en la física teórica había tres opciones: o bien la teoría cuántica de campos y su renormalización debían ser abandonados, o bien la gravedad no era adecuadamente descrita por la relatividad general, o ambas cosas.

Agujeros negros.

Para saber cuál de los dos modelos era el correcto era necesario encontrar algún contexto en el que tanto la gravedad como la teoría cuántica fuesen relevantes, y afortunadamente para nosotros ya existía algo así: las estrellas. Mientras están activas, las estrellas se dedican a fundir núcleos debido a la intensa gravedad que los comprime, y la radiación que liberan estas fusiones en forma de fotones, por el contrario, los empuja hacia fuera de nuevo. Dependiendo del balance entre la gravedad intentando comprimir y la radiación intentando expandir, el tamaño de la estrella se va modificando.

Cuando la actividad nuclear de una estrella se agota y la gravedad pasa a dominar, la minimización de la energía lleva a fenómenos muy interesantes. El más espectacular es la explosión tipo supernova, que hace que la estrella se comprima liberando por el camino gran parte de su masa. El fenómeno es similar al de una desintegración nuclear, en tanto que toda la masa liberada lo hace por reducir la energía neta del sistema. Tras la explosión, normalmente queda como resultado una enana blanca.

Las enanas blancas son estrellas donde lo que lucha contra la gravedad no es la radiación, inexistente debido a su pequeña actividad nuclear, sino el principio de exclusión de Pauli. Si la estrella no se comprime más es porque ello involucraría fermiones en el mismo estado cuántico, lo cual como sabemos está prohibido.

Durante los años treinta, el astrofísico Subrahmanyan Chandrasekhar demostró que este tipo de estrellas debían de tener, como mucho, un 44% más de masa que el Sol, ya que de lo contrario la fuerza gravitatoria superaría con creces la presión cuántica que daría estabilidad a la estrella.

La duda acerca de qué sucedería entonces pudo ser resuelta gracias al descubrimiento del neutrón y las desintegraciones beta. Zwicky propuso la posibilidad de que estas estrellas, las cuales derrocharían un montón de espacio manteniendo sus electrones alejados del núcleo, podrían fundir protones y electrones para dar lugar a neutrones y neutrinos (escapando los últimos de la estrella). De este modo, la estrella estaría compuesta únicamente de partículas de carga neutra del tamaño de un núcleo, y su presión cuántica asociada se multiplicaría al reducirse el tamaño.

Pero del mismo modo que las enanas blancas fallarían por encima de cierta masa, también lo harían las estrellas de neutrones. Robert Oppenheimer y George Volkoff demostrarían así a finales de los años treinta que una estrella de neutrones cuya masa fuese superior al doble de la del Sol tampoco sería estable. El siguiente estadio sería, como sabemos a día de hoy, una estrella de quarks, pero tal objeto no ha sido observado nunca y no tenemos evidencias de que pueda llegar a existir.

¿Y qué pasaría con las estrellas que fuesen incapaces de contrarrestar de modo alguno la gravedad? Pues la relatividad general predecía los famosos agujeros negros, como ya comentamos, aunque Oppenheimer optó por denominarlos estrellas congeladas en un principio. Objetos cosmológicos cuyo horizonte de sucesos supondría una dilatación infinita del tiempo, de modo que nada podría jamás ser visto atravesándolos.

Termodinámica de agujeros negros.

Durante los años sesenta se observaron las primeras estrellas de neutrones en rotación, las cuales resultaron ser descritas de forma bastante certera por las ecuaciones de la relatividad general de Roy Kerr relacionadas con un agujero negro en rotación. En efecto, las estrellas de neutrones, desde la distancia, son muy similares a un agujero negro, obviando el hecho de que pueden liberar un montón de radiación cuando la masa se aproxima a su eje de giro y sale despedida hacia el infinito.

Durante esta época comenzó la que se denomina la era de oro de la relatividad general y los agujeros negros, y comenzó a analizarse en serio las propiedades que tendrían en caso de existir. Wheeler, quien acuñó los términos de agujero negro y agujero de gusano, popularizó entonces una propiedad esencial de los mismos conocida como teorema de no pelo de los agujeros negros. Este teorema decía, en esencia, que un agujero negro se podía caracterizar por completo conociendo su masa, su carga eléctrica y su momento angular, sin necesidad de más datos acerca del mismo.

Pero Wheeler sabía que su teorema era irrespetuoso con las leyes de la termodinámica, y planteó a su discípulo Jacob Bekenstein que analizase cómo podía compatibilizarse con el aumento de la entropía. Si un agujero negro solo dependía de tres parámetros, su entropía sería siempre nula (nunca nos faltaría información), y si su entropía era siempre nula, podría reducirse la del universo lanzando cosas a su interior.

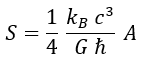

Bekenstein, inspirado por el teorema del área, un resultado debido al cosmólogo Stephen Hawking que nos dice que el área de un agujero negro nunca puede reducirse, llegó a la conclusión de que había una relación entre el área de un agujero negro y su entropía. Su relación de proporcionalidad entre ambas magnitudes llevó a la primera ecuación que involucraba simultáneamente la velocidad de la luz, la constante gravitatoria, la constante de Planck y la constante de Boltzmann, siendo por tanto la primera ecuación que pertenecía simultáneamente a un modelo relativista, gravitatorio, cuántico y termodinámico:

Además, si el agujero negro tuviese carga, la constante eléctrica aparecería dentro de la fórmula de su área.

A Hawking no le gustó este resultado, ya que según reflexionó si el agujero negro tenía energía y entropía, necesariamente tenía que tener temperatura. A su vez, si tenía temperatura y estaba en contacto con el espacio exterior, la termodinámica exigía que emitiese calor (partículas), lo cual contradecía frontalmente la definición del horizonte de sucesos.

No tardó mucho, no obstante, en darse cuenta de que había una forma de que los agujeros negros pudiesen radiar, y esta era debida a la mecánica cuántica. El horizonte de sucesos suponía un límite clásico para que los cuerpos escapasen, pero el principio de incertidumbre podría permitir a la masa en el interior del agujero escapar, del mismo modo que se lo permitía a las partículas alfa y beta separarse de los núcleos. Nació así la termodinámica de los agujeros negros.

Y con dicha rama de la física, llegó también el gran error de Hawking. Intentando combinar la termodinámica con el teorema de no pelo, llegó a la conclusión de que al no haber información dentro de un agujero negro, todo lo que este radiase como radiación Hawking sería aleatorio y, de este modo, cuando un agujero negro se evaporase por su radiación, no quedaría huella alguna de qué fue lo que algún día entró en su interior. Esta era una idea que atentaba contra la mecánica cuántica, y llevó al comienzo de la revolución de la gravedad cuántica.

Principio holográfico.

La mecánica cuántica de Heisenberg y Dirac, e incluso los resultados de Bell, proponían un universo donde los resultados al interactuar con partículas parecían ser impredecibles, pero facilitaba un medio para calcular sus probabilidades. Quizás no podríamos calcular dónde estaría un electrón, pero sí con qué probabilidad estaría en cada lugar.

Las ideas de Hawking, sin embargo, pretendían destruir incluso esto. Según él, lo que radiaría un agujero negro sería completamente aleatorio, destruyendo cualquier posibilidad de analizar la evolución de la onda de Schrödinger de las partículas en su interior hasta que fuesen radiadas. Este problema se conoce como violación de la unitariedad.

Leonard Susskind, otro físico teórico, al escucharle se habría propuesto como meta demostrar que la tesis de Hawking era errónea y una correcta gravedad cuántica debía de ser respetuosa con el principio de unitariedad. Entre los años ochenta y los noventa, fue trabajando en esta idea, hasta que finalmente dio con la solución con la ayuda del físico Gerardus ‘t Hooft.

Sabíamos que en principio nunca podríamos ver nada atravesar un horizonte de sucesos, sino que como mucho podríamos ver cuerpos congelados sobre su superficie padeciendo un efecto Doppler temporal. Por otra parte, desde dicha superficie es desde donde saldría la radiación Hawking despedida hacia fuera. Cabe destacar que aquí, cuando decimos «sobre la superficie», nos referimos a una distancia muy pequeña del horizonte que no llega a ser el propio horizonte.

Por otra parte, sabemos que un cuerpo que cae a través del horizonte, en su sistema de referencia, sí que lo atraviesa hasta llegar a su interior hasta ser desfragmentado y posteriormente radiada toda su masa.

Ambas ideas solo son incompatibles si suponemos que alguien puede observar las dos cosas, pero los observadores o bien están fuera del agujero o bien están dentro, y Susskind y ‘t Hooft propusieron con su principio de complementariedad que ambas versiones de los hechos eran correctas simultáneamente, dependiendo del observador. Pero en cualquier caso el resultado sería el mismo: la información que entra tiene una historia rastreable hasta que es radiada.

De esta idea nació el principio holográfico, aceptado por Hawking, con el cual todo apunta a que el teorema de no pelo siempre fue falso, pues afirma que toda la información en el interior de un agujero negro está codificada en el estado cuántico de su horizonte, de modo que el horizonte sí debe de contener más información que la masa, la carga y el giro para ser descrito correctamente.

Teoría de cuerdas.

Durante los años sesenta, estando todavía sin desarrollar la cromodinámica cuántica como modelo para explicar la interacción nuclear entre quarks, el físico Gabriele Veneziano llegó a la conclusión de que se atraían entre ellos con tirones similares en sentido matemático a aquellos característicos de las cuerdas.

Esto llevó inmediatamente a otros físicos teóricos, entre ellos Susskind, a desarrollar una teoría cuántica del movimiento de las cuerdas para ver si tenía algún tipo de sentido. Llegaron así a la conclusión de que, quizás, todas las partículas estuviesen compuestas por pequeñas cuerdas vibrando, dando lugar así con su energía de vibración a las diferentes masas y espines observados. Sin embargo, la teoría debió ser desechada por dos de sus propiedades: solo podía reproducir bosones y no era compatible con que unas partículas fuesen cuerdas y otras no. Este modelo, la teoría de cuerdas bosónica, cayó en el cajón del olvido, ya que era incapaz de explicar los fermiones.

Sin embargo, de dicha teoría surgieron un par de resultados novedosos: las cuerdas cuánticas podían reproducir el gravitón que predecía la relatividad general de Einstein y el universo debía de constar de veinticinco dimensiones espaciales.

Durante los ochenta, con el desarrollo de la supersimetría, la teoría de cuerdas pudo ser retomada bajo el nombre de teoría de supercuerdas, permitiendo de este modo la existencia de fermiones y rebajando la cantidad de dimensiones espaciales necesarias a diez. Un buen resultado, aunque no suficiente para dar relevancia al modelo.

No sería hasta los años noventa cuando su popularidad se disparase de nuevo gracias al principio holográfico. En primer lugar, Susskind fue capaz de demostrar que un modelo basado en cuerdas podía reproducir a la perfección la radiación de Hawking y la entropía de Bekenstein. En segundo lugar, el físico Juan Maldacena demostró que la teoría de cuerdas era compatible con el principio holográfico, y que la física gravitatoria dentro de un volumen era reproducible por una teoría cuántica de campos en su superficie.

Aunque el resultado de Maldacena solo ha podido ser parcialmente demostrado en el caso de que la teoría de campos sea supersimétrica, hasta ahora es el único modo que hemos encontrado de justificar a nivel cuántico la termodinámica de agujeros negros y, por ese motivo, hace veinte años que la teoría de cuerdas copa los titulares de física teórica con frecuencia.

Las nuevas generaciones de físicos deberán analizar hasta qué punto es la teoría de cuerdas el camino a seguir y cómo encajará finalmente la gravedad con la teoría cuántica de campos.

En este último capítulo, en el que he entrado muy poco en detalles y no he querido hablar de cuestiones más recientes como la teoría de branas, la gravedad cuántica de bucles o la conexión entre el entrelazamiento cuántico y la geometría del espacio-tiempo, he dado unas pocas pinceladas sobre qué resultados teóricos han sido relevantes durante las últimas décadas. A partir de aquí, os invito a seguir aprendiendo con las otras secciones de este blog, o por vuestra cuenta en otros lugares.

NOTA: Toda la serie «Estudiar Física de Bachillerato» ha sido publicada con rapidez por pragmatismo, y durante los siguientes meses se irá actualizando con imágenes, esquemas y soluciones a ejercicios. Podéis ir comentándome todo lo que veáis sobre la misma para que resulte más útil, y espero que os haya sido de ayuda. Cualquier comentario es bien recibido.

Hola Adrian muy buena iniciativa. Vos no me podrias orientar si en internet hay documentacion, libros o cursos sobre gravedad cuantica? Mi interes es solo la lectura y el desafio de enteder algo al respecto. Diria un hobby. MI background es la ingeniería electronica. Desde ya muchas gracias

Hola Gabriel. Si lo que quieres es entender por dónde van los tiros te recomiendo mis dos libros divulgativos de cabecera: «La guerra de los agujeros negros» y «El paisaje cósmico» de Leonard Susskind. De entre todo lo que he leído no hay nada que se les acerque en claridad y profundidad. Además están escritos por uno de los padres de los avances en dicha rama.